Construida sobre la misma base tecnológica que impulsó a Gemini 3, Gemma 4 no solo rompe récords en razonamiento, código y capacidades multimodales, sino que lo hace de una forma radicalmente accesible: modelos que corren en tu teléfono, en una laptop o en un servidor local, bajo una licencia Apache 2.0 completamente permisiva.

¿Qué es Gemma 4?

Gemma 4 no es un solo modelo, sino una familia de cuatro variantes diseñadas para diferentes entornos y necesidades de hardware:

- E2B (Effective 2B) y E4B (Effective 4B): Modelos ultracompactos optimizados para dispositivos móviles, edge computing, navegadores y smartphones (como Pixel).

- 26B MoE (Mixture of Experts, activo ~4B): Un equilibrio entre potencia y eficiencia.

- 31B Dense: El modelo más potente de la familia, ideal para workstations y servidores locales.

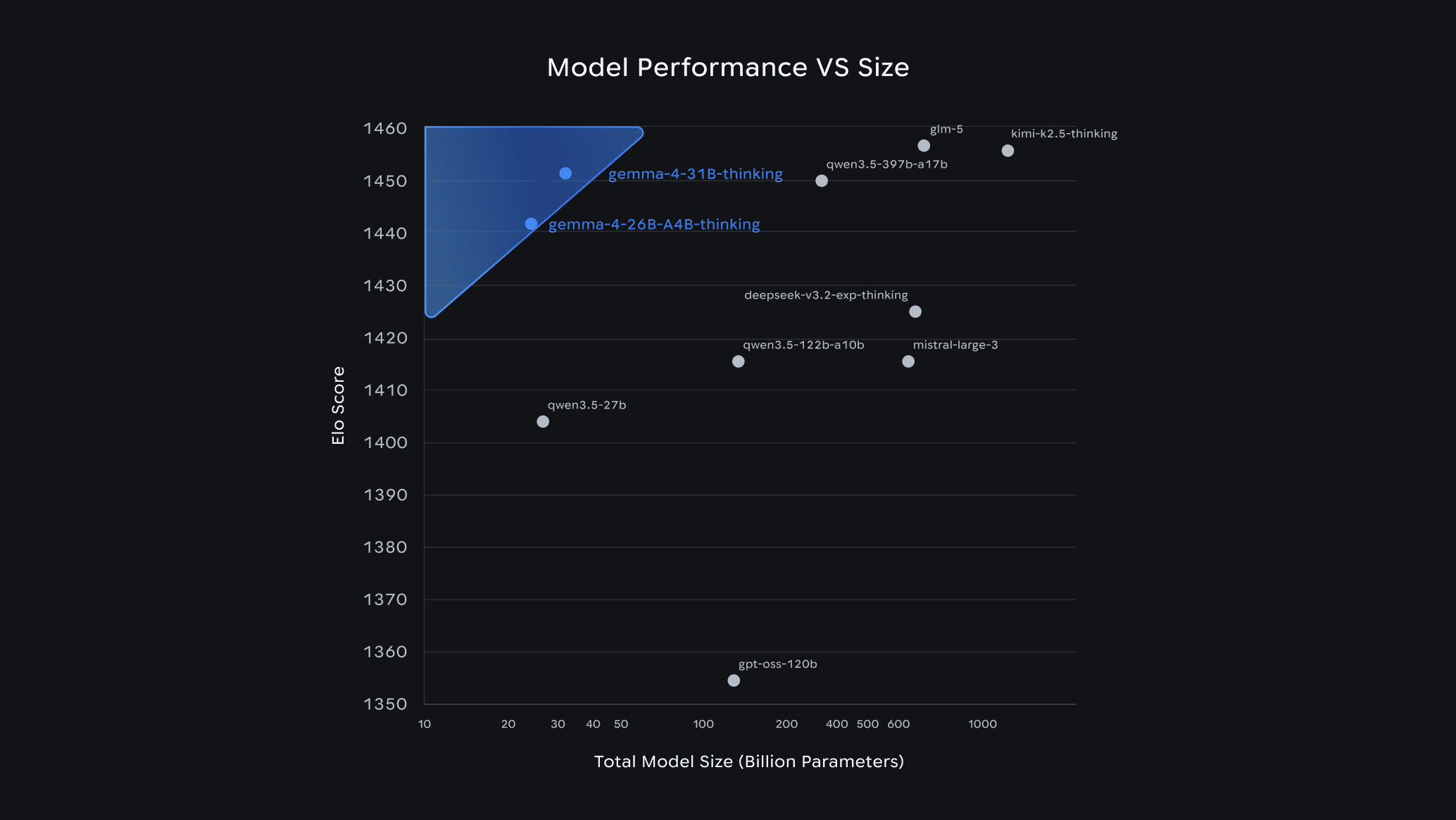

Estas versiones logran un rendimiento impresionante «byte por byte», superando en muchos casos a modelos mucho más grandes (hasta 20 veces su tamaño).

Características principales

- Multimodal nativo — Soporta texto, imágenes y audio (especialmente en los modelos pequeños). Puede procesar entradas visuales y auditivas sin necesidad de fine-tuning especializado.

- Contexto largo — Hasta 256K tokens, perfecto para documentos extensos, código grande o conversaciones prolongadas.

- Más de 140 idiomas — Excelente soporte multilingüe desde el primer día.

- Agéntico y razonamiento avanzado — Destaca en planificación multi-paso, uso de herramientas, generación de código offline y flujos de trabajo autónomos.

- Función calling nativa — Facilita la integración con sistemas externos.

- Eficiencia extrema — Los modelos pequeños corren en hardware de consumo (incluso en un solo GPU de 80 GB para los más grandes).

Rendimiento en benchmarks

Gemma 4 marca un avance notable respecto a Gemma 3:

| Benchmark | Gemma 4 31B | Gemma 4 26B MoE | Gemma 4 E4B | Gemma 3 27B |

|---|---|---|---|---|

| Arena AI (chat) | 1452 | 1441 | — | 1365 |

| MMMLU (multilingüe) | 85.2% | 82.6% | 69.4% | 67.6% |

| MMMU Pro (multimodal) | 76.9% | 73.8% | 52.6% | 49.7% |

| AIME 2026 (Matemáticas) | 89.2% | 88.3% | 42.5% | 20.8% |

| LiveCodeBench (Código) | 80.0% | 77.1% | 52.0% | 29.1% |

| GPQA Diamond (Ciencia) | 84.3% | 82.3% | 58.6% | 42.4% |

Los modelos destacan especialmente en razonamiento matemático, código competitivo y tareas agenticas.